Deepfake “da star” con l’IA di ByteDance: quando la viralità diventa rischio

Si diffondono online deepfake realizzati con strumenti basati su IA: volti celebri e clip ultra-realistiche diventano facili da produrre e condividere.

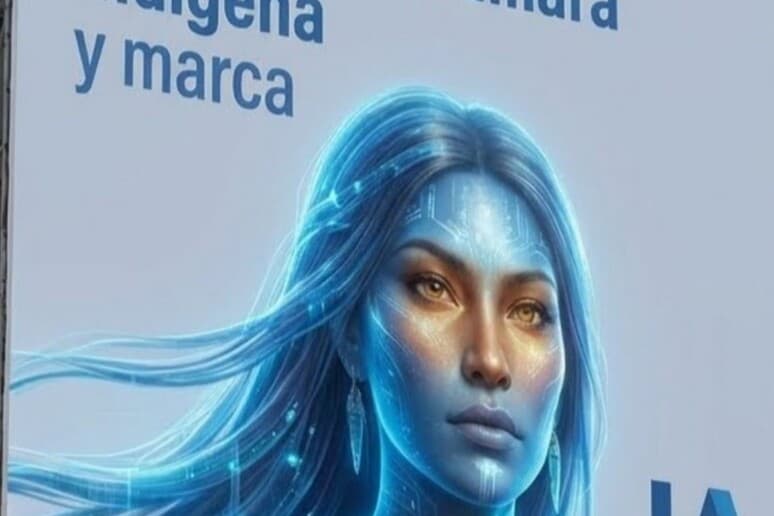

Il confine tra intrattenimento e manipolazione si assottiglia: deepfake sempre più credibili stanno spopolando sulle piattaforme, grazie a strumenti di intelligenza artificiale. Il deepfake non è solo “meme”: può essere usato per truffe, disinformazione, revenge porn o frodi d’identità. Più la tecnologia è semplice, più cresce il rischio di utilizzi impropri. Negli ultimi giorni circolano contenuti deepfake che sfruttano sistemi di generazione basati su IA attribuiti a ByteDance: video e immagini in cui volti noti vengono ricostruiti con elevata verosimiglianza. La dinamica è tipica: clip brevi, altamente condivisibili, che sfruttano l’effetto “wow” per ottenere visualizzazioni, spesso senza contesto o indicazioni chiare di contenuto sintetico. L’impatto è immediato sul pubblico: aumenta la difficoltà di distinguere reale e falso, soprattutto su video verticali e visualizzazione rapida. Cresce anche il rischio di frodi “a nome di” personaggi famosi o aziende, e di campagne di disinformazione costruite per sembrare autentiche. Il tema torna quindi su etichettatura, trasparenza e strumenti di verifica. In una regione dove social e messaggistica sono centrali per informarsi e fare acquisti, video falsi possono colpire chiunque: dal cittadino che crede a un “annuncio” al piccolo imprenditore vittima di imitazioni. Educazione digitale e controlli più forti servono anche sul territorio.

Written by

BRUTTO ALESSANDRO